Je vous propose dans cet article de créer un réseau de neurones à convolution pour faire du NLP, et pour les données j’utiliserai un jeu de données que vous pouvez trouver simplement dans les datasets Kaggle : FrenchFakeNewsDetector. Vous l’avez compris l’objectif est double: d’une part voir comment on pourra utiliser la technique de convolution avec des vecteurs (1 dimension au lieu d’images à 2+ dimensions) et d’autre part de faire du NLP avec des données en Français.

Fake news ?Catégorie : Intelligence Artificielle

L’Intelligence Artificielle est au coeur de nos vies et de nos usages. Dans ces articles nous verrons comment cette fameuse IA fonctionne, quels sont ses mécanismes et ce que l’on peut en faire.

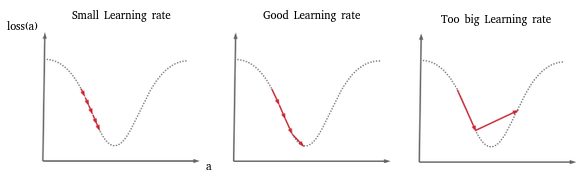

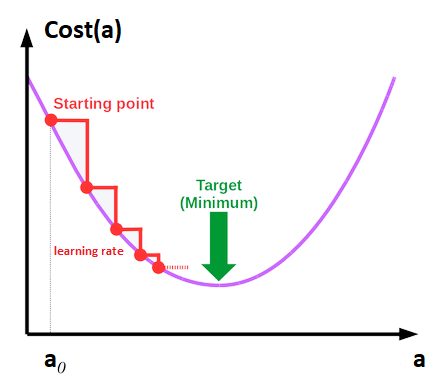

Descente de Gradient Stochastique (SGD) & Learning Rate

Une fois terminé l’article sur la descente de gradient, je me suis rendu compte qu’il manquait deux points important. Le premier concerne l’approche stochastique dés lors que l’on a des jeux de données trop importants, le second étant de voir très concrètement ce qui se produit quand on choisit mal la valeur du learning rate. Je vais donc profiter de cet article pour finalement continuer l’article précédent 😉

Descente de Gradient Stochastique (SGD) & Learning RateLa descente de gradient

Comment parler de Machine Learning ou même de Deep Learning sans aborder la – fameuse – descente de gradient ? Il y a beaucoup d’articles sur ce sujet bien sur mais bien souvent il faut lire plusieurs afin de bien en comprendre tous les mécanismes. Souvent trop mathématiques ou pas assez, je vais essayer surtout ici d’expliquer son fonctionnement en douceur et pas à pas afin de tenter une démystification du sujet.

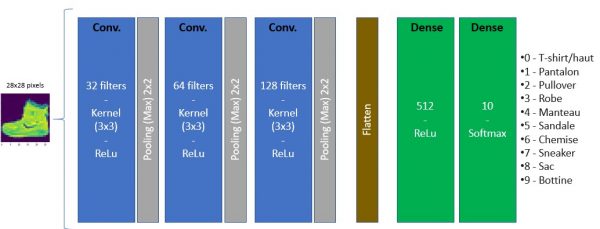

La descente de gradientTraitement d’images (partie 7: Les Réseaux de neurones à convolution – CNN)

Dans cet article nous allons voir pas à pas comment créer et utiliser un réseau de neurone convolutif (CNN) pour classifier des images.

Traitement d’images (partie 7: Les Réseaux de neurones à convolution – CNN)