Vous avez remarqué ? on ne parle plus ou presque de Big Data ! Pourtant ce « Buzword » a été au cœur de la stratégie marketing de beaucoup d’entreprises et d’éditeurs de logiciels ces dix dernières années. Mais le buz commence à faire flop, qu’en est-il réellement ? il est en effet difficile d’imaginer que le déluge de données n’aura pas lieu. En fait c’est plutôt le contraire. Le déluge est bien là, la croissance des données stockées est présente. Et c’est pas vraiment prêt de s’arrêter là.

La fin d’un Buz ? le début d’un autre …

Faire de l’Hadoop pour faire de l’Hadoop – comme on l’a vu – n’a naturellement aucun sens ! Il faut parfois laisser la nature agir, la sélection naturelle fait alors son oeuvre. Si on jette (après une dizaine d’année) un coup d’œil aux projets Hadoop qui existent encore et qui se développent on trouvera alors quel sens cette technologie a naturellement prit sur le marché.

Mais alors pourquoi ne parle-t-on plus de Big Data ? en fait, pour être plus précis pourquoi ne parle-t-on plus de Hadoop (bien sur il faut différencier ces deux termes) ? si la problématique de gestion des données en masse n’a pas disparue – bien au contraire -, c’est plutôt celle des moyens de la gérer qui est en train de disparaître des écrans radar de la presse. En fait, la véritable question autour de la croissance des données, n’est t’elle pas : que va-t-on en faire ?

Ces dernières années les entreprises se sont donc attelée à gérer le comment … désormais on s’interroge plus sur le pourquoi. Heureusement il semblerait qu’un sens, une utilité devrais-je dire pour ces données émerge grâce à l’Intelligence Artificielle. Rien de bien nouveau non plus là dedans si ce n’est que la combinaison de plusieurs facteurs – dont l’explosion des données – qui redonne un coup de boost à l’IA. Celle-ci peut désormais afficher des taux de confiance impressionnant.

L’IA se nourrissant des Big Data … c’est plutôt pertinent en fait, et ça arrive même à point nommé.

Hadoop: en route vers une quête de sens

Sous ce titre quelque peu provocateur se cache une réelle interrogation marketing. Mais d’ailleurs qu’est-ce qu’Hadoop ?

Hadoop est un framework libre et open source écrit en Java destiné à faciliter la création d’applications distribuées (au niveau du stockage des données et de leur traitement) et échelonnables (scalables) permettant aux applications de travailler avec des milliers de nœuds et des pétaoctets de données. Ainsi chaque nœud est constitué de machines standard regroupées en grappe. Tous les modules de Hadoop sont conçus dans l’idée fondamentale que les pannes matérielles sont fréquentes et qu’en conséquence elles doivent être gérées automatiquement par le framework.

Wikipédia

Hadoop ce n’est donc pas le Big Data, c’est une façon de gérer des Big Data !

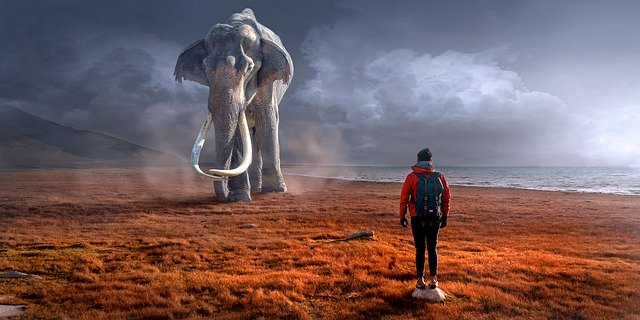

Au delà de la définition technique de Wikipédia il faut se rappeler qu’Hadoop à fait son apparition en 2008 sous la forme du projet Open Source du même nom. C’est alors le début d’un Buz marketing incroyable qui va durer environ 10 ans. Bien sur cette notoriété va suivre une courbe de distribution normale en terme d’appétence. A son point culminant, au début des années 2010, il est clair que toutes les DSI se devaient d’avoir leur projet Big Data tournant sur un cluster Hadoop. Un vrai must pour toute direction informatique qui se voulait innovante. A l’heure du bilan, combien de projet on été réellement donné lieu à des projets de type opérationnels en production? Bizarrement on trouve beaucoup moins de statistiques sur ce point. Combien ont réussi à dompter réellement l’éléphant? Peu apparemment.

C’est pas non plus vraiment étonnant. Si la technologie Hadoop et truffée de qualité -mais aussi d’autant de limites – , son premier soucis est que derrière l’enthousiasme grandissant autour de cette technologie, tout le monde à voulu l’utiliser rapidement. On en a alors mis un peu partout, souvent pour essayer. Malheureusement cette technologie ne pouvait répondre à tous les cas d’usage et en outre a mis des années à se stabiliser. Beaucoup (trop) échecs projets (Cf. article du Silicon) se sont alors succédé.

Personnellement j’y vois 3 raisons majeures :

- La technologie Hadoop n’est pas adaptée à tout type de stockage de données (Opérationnel vs Décisionnel). Cela peut paraître évident mais bien souvent des choix se sont portés sur Hadoop seulement sur des critères de coûts (car Open Source). Or pour citer Nick Heudecker il est illusoire de penser qu’Hadoop va remplacer toutes les bases de données !

- Les compétences demandées pour mettre en place et faire exister un cluster hadoop sont rares, et il en faut parfois beaucoup pour maintenir un cluster opérationnel.

- Cette technologie est trop complexe car elle est en fait un assemblage de multiples de technologies (elles aussi Open Source : HDFS, YARN, MapReduce, SPARK, ZooKeeper, HBASE, PIG, HIVE, etc.). Résultat un système hadoop est en constante mise à jour (ou presque) la mise à jour d’un seul composant « mettant potentiellement en danger » les autres composants (d’où l’emergence des distributions).

Quel avenir donc pour Hadoop ?

Finalement les échecs de projets Hadoop ne sont pas vraiment des échecs technologiques mais plutôt des erreurs de jeunesse d’une technologie et d’un marché qui avait besoin de trouver sa place dans un écosystème informatique complexe et en pleine mutation. La preuve en est d’ailleurs de la fusion des deux géants du domaine Cloudera & Hortonworks. Le marché s’est resserré récemment pour se refocaliser sur son essencer.

Stocker les données en masse issuees des IOT par exemple ou autres sondes de données au lieu de vouloir remplacer les bases de données à tout prix par exemple. Ajouté à cela la vulgarisation du cloud qui met à mal ces technologies complexes à mettre en oeuvre, on comprend mieux alors pourquoi les entreprises préférent de plus en plus déléguer cette complexité à des services tiers.

Donner enfin une utilité à toutes ces données

Pour tout ceux qui avaient conçu leur datalake – un peu sous l’impulsion de se phénomène de mode – se pose alors une question. Qu’en faire bien sur ? Difficile de s’en servir comme DataWarehouse (ou alors dans certains cas d’usages finalement assez limités), il faut rentabiliser ces fameux puits de données qui ont en plus pour propriété naturelle de grandir.

A bien y regarder, il y a un domaine qui a besoin de beaucoup de données pour exister. C’est bien sur l’Intelligence Artificielle et plus particulièrement le Machine Learning (dans lequel j’incorpore le Deep Learning). Fonctionnant dans une logique d’apprentissage ces algorithmes ont besoin de beaucoup mais alors beaucoup ingérer de données pour être efficaces et pertinents. Le Datalake est donc une parfaite source de données pour ces algorithmes.

D’ailleurs, Machine Learning et Deep Learning ne sont pas vraiment nouveau. La plupart des algorithmes qui sont sous jacents à l’IA ne sont pas tout jeunes et sont d’ailleurs utilisés depuis bien longtemps (Bayes, arbres de décision, etc.). La véritable nouveauté pour l’IA c’est que maintenant les données pour faire apprendre à ces algorithmes sont bien là mais aussi la puissance des machines est elle aussi en pleine croissance.

Et voilà comment les datalake sont et deviennent de plus en plus les sources de données principales de nos chers Data-Scientists. Libre à eux d’y puiser les précieuses données dont ils ont besoin pour produire leurs analyses … mais ça c’est encore une autre histoire.

Conclusion

Bon alors, Hadoop est-il mort ?

Pas vraiment … disons que sa fonction par contre s’est refocalisée pour devenir ce qu’elle n’aurait jamais du cesser d’être à savoir un outil de gestion de puits de données massif et hétérogène. Un véritable puits de données dans lequel on stocke tout type d’information pour pouvoir y plonger un seau vide. Bien sur, on ne sait pas forcément dans combien de temps on va pouvoir le remonter mais une seule chose reste sure : le seau sera plein 😉

Son utilisation s’est donc trouvée naturellement – pour ceux dont l’utilité de posséder autant de données était réellement un enjeu -. Laquelle ? et bien pour produire de l’analytique et du prédictif. S’était d’ailleurs pour celà qu’Hadoop avait été conçu initialement: pour pouvoir nourrir des modèles analytiques et prédictifs efficace ! On peut dire qu’Hadoop revient naturellement à sa fonction première donc, tout simplement.

N’hésitez pas à réagir en postant un commentaire ci-dessous.

Ingénieur en informatique avec plus de 20 ans d’expérience dans la gestion et l’utilisation de données, Benoit CAYLA a mis son expertise au profit de projets très variés tels que l’intégration, la gouvernance, l’analyse, l’IA, la mise en place de MDM ou de solution PIM pour le compte de diverses entreprises spécialisées dans la donnée (dont IBM, Informatica et Tableau). Ces riches expériences l’ont naturellement conduit à intervenir dans des projets de plus grande envergure autour de la gestion et de la valorisation des données, et ce principalement dans des secteurs d’activités tels que l’industrie, la grande distribution, l’assurance et la finance. Également, passionné d’IA (Machine Learning, NLP et Deep Learning), l’auteur a rejoint Blue Prism en 2019 et travaille aujourd’hui en tant qu’expert data/IA et processus. Son sens pédagogique ainsi que son expertise l’ont aussi amené à animer un blog en français (datacorner.fr) ayant pour but de montrer comment comprendre, analyser et utiliser ses données le plus simplement possible.

One Reply to “Le big data est-il mort ? Vive le Machine Learning”